Nuevos vectores de ataque a la IA

La implementación de nuevos canales e infraestructuras junto con la falta de visibilidad unificada hacen que las organizaciones sean susceptibles a nuevos ataques.

Nuevos vectores de ataque a la IA

La implementación de nuevos canales e infraestructuras junto con la falta de visibilidad unificada hacen que las organizaciones sean susceptibles a nuevos ataques.

Abordar problemas de proliferación de modelos

La falta de inventario de IA puede conducir a modelos de IA en las sombras, infracciones de cumplimiento y filtración de datos a través de aplicaciones con tecnología de IA.

Falta de gobernanza

La nueva legislación centrada en la IA exige controles estrictos sobre el uso de la IA y los datos de los clientes que se introducen en las aplicaciones con tecnología de IA.

Maximice los beneficios transformadores de la IA y los modelos de lenguaje grande (LLM) sin poner en riesgo a su organización. La gestión de la postura de seguridad de IA (AI-SPM) de Prisma® Cloud le da visibilidad y control sobre los tres componentes críticos de su seguridad de IA: los datos que utiliza para entrenamiento o inferencia, la integridad de sus modelos de IA y el acceso a sus modelos implementados.

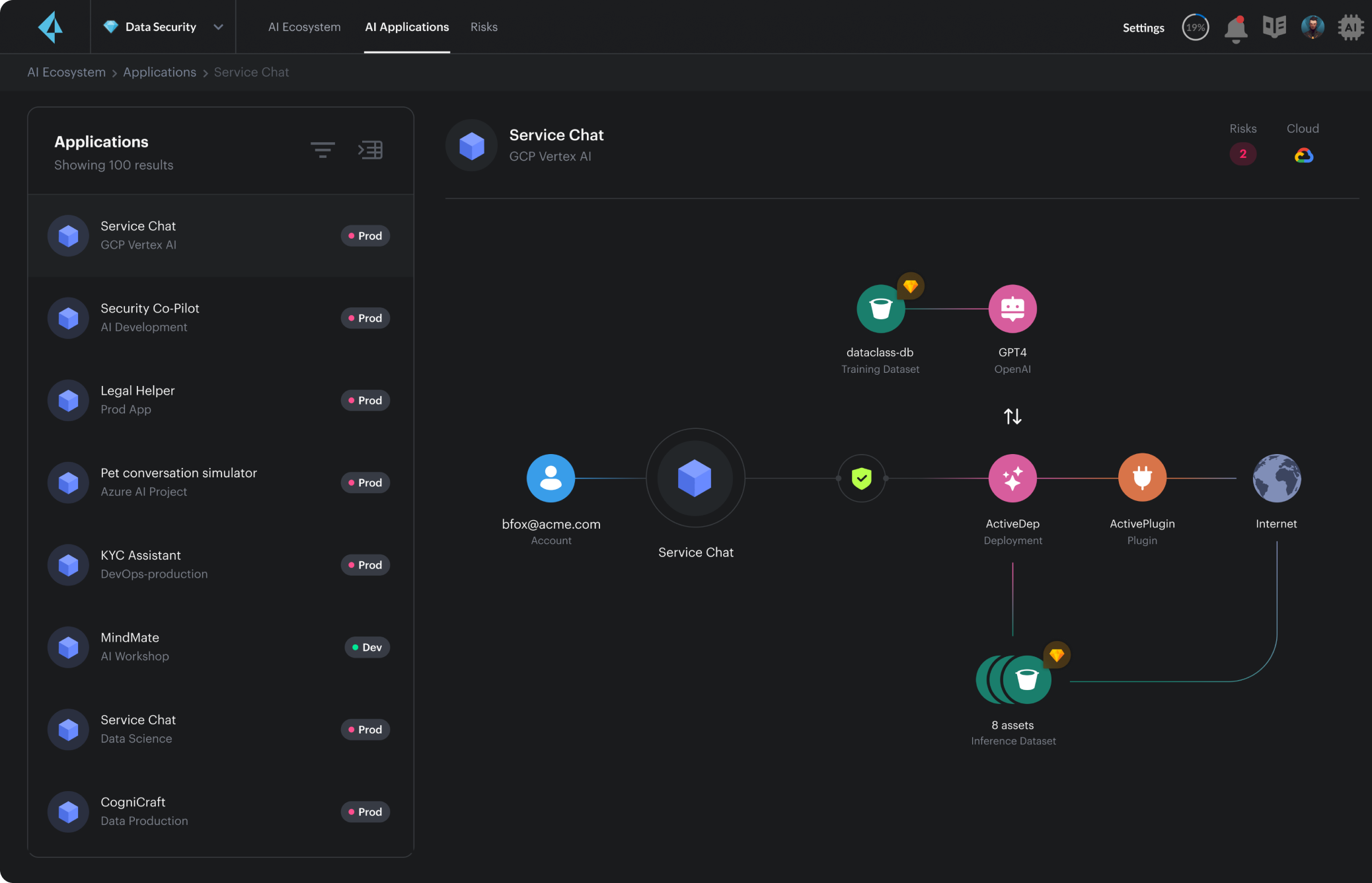

Descubra todas las aplicaciones con IA, modelos y recursos asociados. Identifique y rastree el linaje de los componentes de IA utilizados en las aplicaciones.

Detección de la pila de aplicaciones con IA

Descubra todas las aplicaciones con IA, modelos y recursos asociados.

Linaje de la IA

Identifique y rastree el linaje de las fuentes de datos y los componentes de IA utilizados en las aplicaciones.

Inventario de modelos

Catalogue los modelos de IA implementados e identifique las actualizaciones.

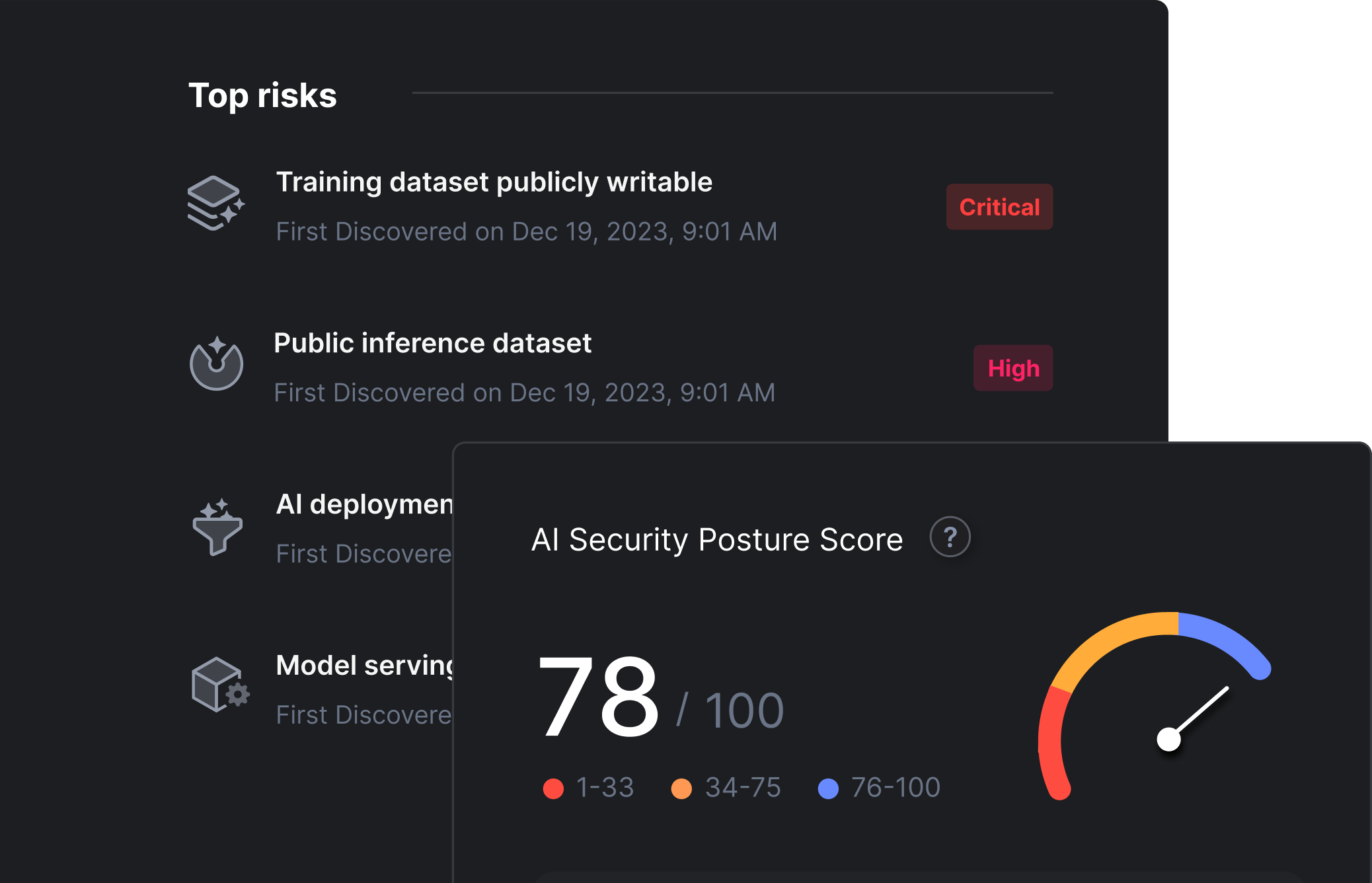

Identifique las vulnerabilidades en la cadena de suministro de IA y busque modelos mal configurados y recursos en la nube relacionados que puedan conducir a la manipulación, el uso indebido y el robo.

Prevenir las vulneraciones y el robo de modelos

Mediante la identificación de los riesgos de los adversarios para crear un equivalente funcional.

Buscar errores de configuración

Mediante la reducción de las instancias informáticas y los modelos con privilegios excesivos.

Evitar el diseño inseguro de complementos

Mediante la identificación de agentes/cargas de trabajo con privilegios excesivos y vulnerables.

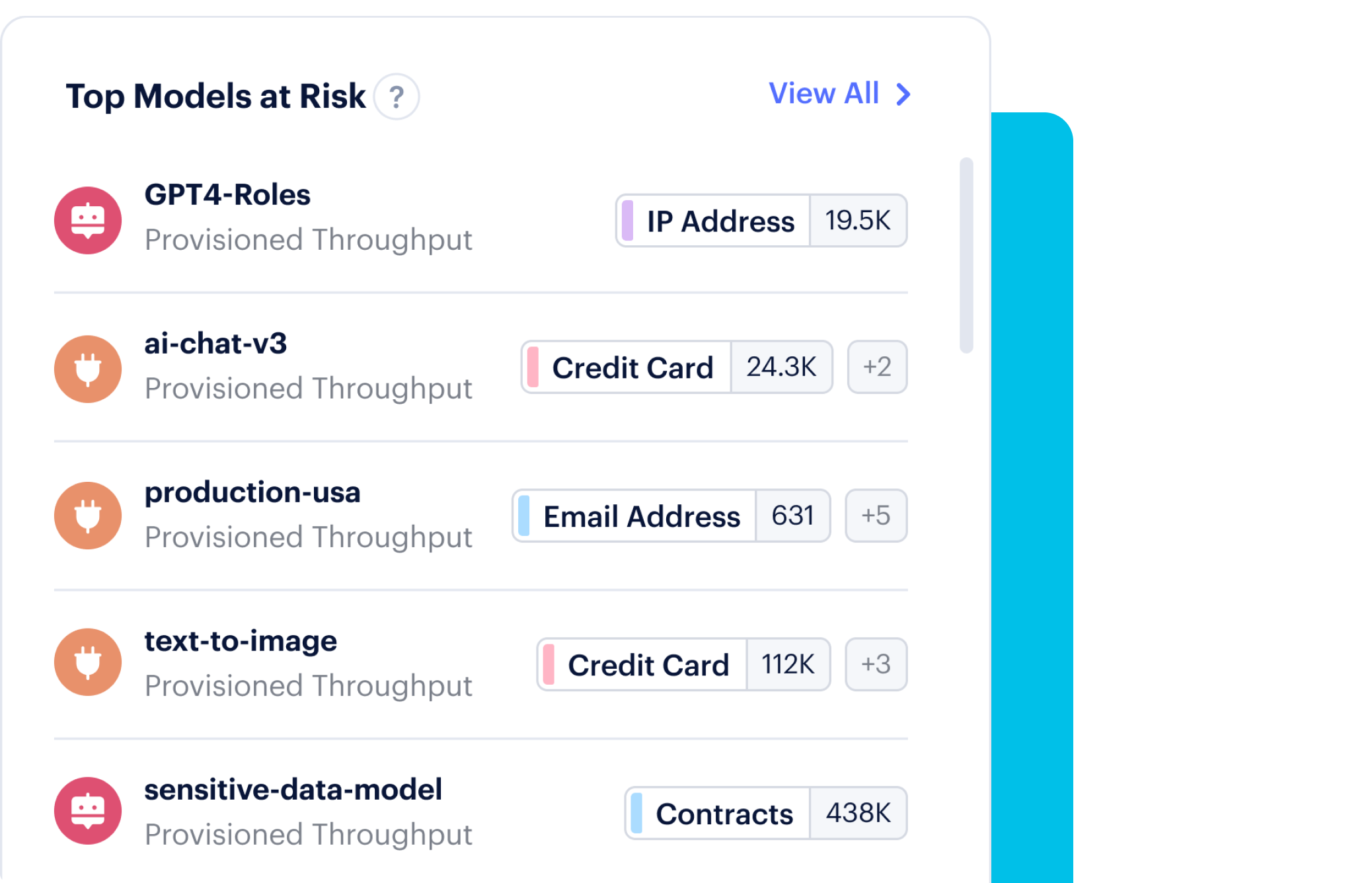

La manipulación de los datos de los modelos puede introducir vulnerabilidades y sesgos, exponer datos y provocar violaciones de la privacidad de los datos, así como riesgos de seguridad y cumplimiento.

Clasificar la pila de IA

Identifique dónde existen datos confidenciales en los datos de entrenamiento y referencia, las bibliotecas, las API y los canales de datos que alimentan los modelos de IA.

Supervisar los datos confidenciales

Supervise y controle la exposición de los datos, el riesgo de envenenamiento, las violaciones de la privacidad y las vulneraciones de seguridad.

Priorizar las vulnerabilidades

En la infraestructura que aloja IA que está accediendo a datos confidenciales.